هوش مصنوعی : خالق یا مبدع؟

هوش مصنوعی (AI) قادر به تمایز میان واقعیت و داستان نیست. همچنین خلاق نیست و نمیتواند محتوای جدیدی خلق کند، بلکه فقط آنچه قبلاً گفته شدهاست را تکرار، بازنویسی و بازسازی میکند (البته شاید به روشهای جدید).

خلاقیت هوشمند: واقعیت یا توهم؟

اطمینان دارم که برخی با بخش پایانی متن مخالفت خواهند کرد؛ شاید به این نکته اشاره کنند که هوش مصنوعی به وضوح قادر به خلق آثار جدید، مانند ترانه و شعر است. با وجودِ اینکه من با ادعای فوق موافقم، اما این ادعا نکتهی اصلی سخنم را نادیده میگیرد. هوش مصنوعی تنها با تکیه بر دادههای ترانهها و اشعار پیشین، “ترانهای جدید” میسازد، در حقیقت هوش مصنوعی از این اطلاعات (الگوهای استخراج شده استقرایی) برای تولید متنهایی استفاده میکند که برای ما به منزلهی یک ترانهی جدید به نظر میرسد (شاید هم واقعا چنین باشد). با این حال، هیچ هنرمندبودگی یا خلاقیت واقعی در آن وجود ندارد. این تنها یک بازآفرینی ساختاری از دادههای موجود است.

پرامپت نویسی : چگونه هوش مصنوعی را به بردهی خود تبدیل کنیم!

برتری انسان: خطا به مثابه مزیت

البته، میتوان در مورد چگونگی تفکر انسان و میزان بداعت و نوآوری اندیشههای او و اینکه آیا یادگیری انسان صرفاً یا عمدتاً بر پایه تقلید استوار است یا خیر به بحث پرداخت. با این حال، حتی اگر به خاطر استدلال فرض کنیم که تمام دانش و کردار ما صرفاً بازتولید است، انسانها ظرفیت محدودی برای به خاطر سپردن دقیق وقایع دارند و در نتیجه دچار خطا میشوند. همچنین ما با برداشتهای ذهنی (نه عینی) خود، شکافهای اطلاعاتی را پر میکنیم (آزمون رورشاخ را به یاد بیاورید). حتی در این سناریوی بسیار محدود، که با آن موافق نیستم، انسانها خلاقیت و نوآوری بیشتری نسبت به هوش مصنوعی از خود نشان میدهند.

هم ناتوانی در تشخیص واقعیت از داستان و هم وابستگی استنتاجی به الگوی دادههای موجود، مشکلاتی هستند که میتوانند از طریق برنامهریزی و برنامهنویسی حل شوند، اما در عین حال بستری برای دستکاری و سوءاستفاده نیز مهیا میکنند.

سوءاستفاده و پروپاگاندا | هوش مصنوعی در خدمت ایدئولوژی

هنگامی که گوگل هوش مصنوعی جِمینای خود را در ماه فوریه 2023 راهاندازی کرد، بلافاصله مشخص شد که این هوش مصنوعی دارای سوگیری خاصِ به اصطلاح “بیداری (Woke)” است و مغرضانه و جانبدارانه عمل میکند. هوش مصنوعی مذکور، ایدهآلهای تنوعطلبانهی این جریانِ خاص را در هر پاسخِ قابل تصوری وارد میکند و از نمایش تصاویر افراد سفیدپوست (از جمله هنگام درخواست برای تولید تصاویر پدران بنیانگذار آمریکا) امتناع میورزد.

روشهای نوین جستجو در گوگل – مروری بر ابتکارات گوگل در جستجوی تصویری و متنی

“میدانم باورکردنش سخت است، اما هوش مصنوعیِ غولهایِ فناوری، خروجیای که ارائه میدهد را به این دلیل تولید میکند که دقیقا در حال اجرای دستورالعمل خاص، ایدئولوژیک، رادیکال و مغرضانهی سازندگانش است. خروجی ظاهرا عجیب و غریب آن ۱۰۰٪ عمدی است. این هوش مصنوعی همانطور که طراحی شده کار میکند.”

مارک اندرسن، سرمایهگذار در Silicon Valley، در X (توییتر سابق):

ابزارهای مختلفِ هوش مصنوعی، فراتر از موتورهای دستهبندی و تولید صِرف، از یک طراحیِ هدفمند برخوردارند. خروجیهای آنها کاملاً استقرایی (استنتاجی مبتنی بر مشاهدات) یا تولیدی نیستند. بخشی از این امر برای کاربردی بودن هوش مصنوعی ضروری است: فیلترها و قوانینی اعمال میشوند تا اطمینان حاصل شود پاسخهای تولید شده توسط هوش مصنوعی مناسب، همسو با انتظارات کاربر و همچنین دقیق و محترمانه باشند. همچنین، با توجه به وضعیت حقوقی، سازندگان هوش مصنوعی باید اطمینان حاصل کنند که ابزار آنها، برای مثال، قوانین مالکیت معنوی را نقض نکند یا درگیر نفرتپراکنی علیه افرادی خاص نشود. هوش مصنوعی همچنین به گونهای طراحی (هدایت) میشود که از کنترل خارج نشده و کاربران خود را آزرده نکند.

تاثیر منفی قوانین اتحادیه اروپا بر فضای مجازی و آزادی اینترنت

مهندسی پاسخها: هدایت کاربران با هوش مصنوعی

با این حال، از آنجایی که چنین فیلترهایی اعمال میشوند و میشود چنین گفت که “رفتارِ” هوش مصنوعی از پیش هدایت شدهاست، کمی پیشتر بردن و کنترل بیشتر آن کار سادهای است. با این حال، چه زمانی یک پاسخ بیش از حد توهینآمیز در نظر گرفته میشود؟ یا چه زمانی پاسخی که توهینآمیز است، در محدوده گفتمانِ مجاز قرار میگیرد؟ این مرزی ظریف و دشوار است که باید ازطریق برنامهریزی و برنامهنویسی (programmatically) مشخص شود.

هوش مصنوعی هم راه با جهتگیریِ واقعی

اعمال چنین فیلترهایی، فراتر از صرف اطمینان از کیفیت پاسخها، امکان هدایت آنها را فراهم میکند. با وجود فیلترهای از پیش تعیینشده، به راحتی میتوان هوش مصنوعی را وادار به تولید اظهاراتی از نوع خاص یا جهتدهیِ ظریف کاربر به سمتی خاص (از نظر انتخاب حقایق، تفاسیرها و جهانبینیها) کرد. همانطور که آندرسن اشاره میکند، این امر میتواند برای القای یک دستورالعمل خاص به هوش مصنوعی، مانند جهتگیری دائمی به سمت “بیداری اجتماعی (Woke)” به کار رود.

در نتیجه، هوش مصنوعی میتواند به عنوان یک ابزارِ تبلیغاتِ سیاسیِ مؤثر مورد استفاده قرار گیرد، موضوعی که هم شرکتهای سازنده این فناوری و هم دولتها و سازمانهای نظارتی بر آن اذعان دارند.

اطلاعات گمراهکننده و کژراهی

دولتها مدتهاست از پذیرفتن این موضوع که از پروپاگاندا برای هدایت و کنترل شهروندان خود سود میبرند، سر باز میزنند. بخشی از این موضوع به این علت است که آنها میخواهند چهرهی مشروع خود را به عنوان دولتهای دموکراتیکی که بر اساس عقاید مردم (و نه بر اساس شکلدهی عقاید آنها) حکومت میکنند، حفظ نمایند. پروپاگاندا معنای ناخوشایندی دارد؛ زیرا ابزاری برای کنترل است.

با این حال، گفته میشود دشمنان دولت، چه داخلی و چه خارجی، قدرت پروپاگاندا را درک میکنند و در استفاده از آن برای ایجاد هرج و مرج در جامعهی دموکراتیک ظاهراً بیعیب و نقص ما تردید نمیکنند. آنها ادعا میکنند دولت باید ما را از چنین دستکاریهایی نجات دهد. البته، این اقدامات به ندرت تنها به دفاع ختم میشوند. همانطور که در طول همهگیری کووید به وضوح دیدیم، دولتها به همراه شرکتهای رسانههای اجتماعی، عملاً ابراز عقیدهای که مطابق با خط مشی رسمی نبود را غیرقانونی اعلام کردند.

هوش مصنوعی: ابزار جدید پروپاگاندا

هوش مصنوعی به اندازه الگوریتمهای شبکههای اجتماعی، به سادگی برای اهداف تبلیغاتی قابل سوءاستفاده است، اما با این مزیتِ مضاعف که تنها بر نظرات افراد تأثیر نمیگذارد، بلکه کاربران تمایل دارند آنچه را که هوش مصنوعی گزارش میکند، به عنوانِ حقیقت تلقی کنند. همانطور که در مقاله قبلی در مورد انقلاب هوش مصنوعی دیدیم، متقن شمردن خروجیهای هوشمصنوعی یک تصور باطل است، با این وجود، متاسفانه این عقیده به طور گسترده پذیرفته شدهاست.

اگر هوش مصنوعی را بتوان به گونهای برنامهریزی کرد که در مورد موضوعات خاصی که سازندگان (یا قانونگذاران) نمیخواهند مردم ببینند یا یاد بگیرند، اظهارنظری نکند، عملاً آن اطلاعات را به “گودِ حذفیات” انداختهایم و دچار “فراموشی تاریخی” شدهایم. این نوع اطلاعات “نامطلوب” با عدم مواجهه مردم با آنها، شیوع نخواهندیافت، مانند نمایش تصاویر متنوعی از پدران بنیانگذار آمریکا (مانند هوش مصنوعی جِمینایِ گوگل) یا ارائه حقایق اقتصاد کلان کینزی (Keynesian economics) برای القای این تصور که هیچ دیدگاه دیگری وجود ندارد.

همانطور که گفتهشدهاست، مردم از آنچه نمیدانند (با آن مواجه نمیشوند)، بیخبرند.

حقیقتزدایی: وقتی هوش مصنوعی پنهان میکند

البته، هیچ تضمینی وجود ندارد که آنچه به کاربر ارائه میشود، حقیقت داشته باشد. در واقع، هوش مصنوعی خود به تنهایی قادر به تشخیص واقعیت از حقیقت نیست، بلکه تنها بر اساس دستوراالعملها و بر پایه اطلاعاتی که به آن داده شدهاست، پاسخهای خود را تولید میکند. این امر زمینهی گستردهای برای تحریف یا بدنمایی حقیقت فراهم میآورد و میتواند جهان را وادار به باورِ دروغهای صریح کند. بنابراین، هوش مصنوعی به راحتی قابل سوءاستفاده به منظورِ اعمال کنترل است، خواه دولتی بر شهروندان تحت حاکمیت آن، یا حتی یک قدرتی خارجی بر کشورهای دیگر.

تهدید واقعی هوش مصنوعی | فراتر از داستانهای علمی-تخیلی

همانطور که در مقالهی اول (درک انقلاب هوش مصنوعی | واقعیت یا توهم؟) دیدیم، مدلهای زبان بزرگ به هوش مصنوعی عمومی (Artificial General Intelligence) تبدیل نخواهندشد (نمیتوانند بشوند)؛ زیرا غربال کردن استقرایی حجم عظیمی از اطلاعات ایجاد شده توسط انسان، منجر به پدید آمدن آگاهی نمیشود. صریح بگویم، ما حتی ماهیت آگاهی را هم به طور کامل درک نکردهایم، بنابراین تصور این که ما هوش مصنوعی عمومی را خلق خواهیم کرد (یا اینکه این هوش مصنوعی به نوعی از طریق کشف همبستگیهای آماری زبانی در متون موجود پدیدار خواهد شد) کمی اغراقآمیز است. هوش مصنوعی عمومی هنوز در حد یک فرضیه باقی میماند.

تهدیدِ (؟) اقتصادیِ هوش مصنوعی

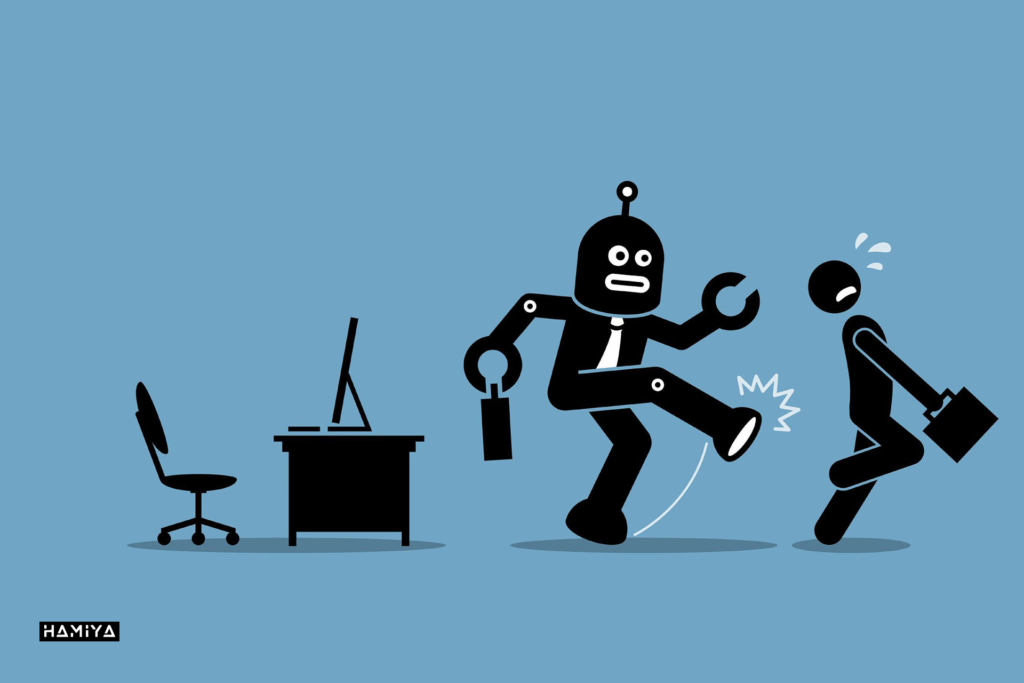

از طرفی همانطور که در مقاله دوم (انقلاب هوش مصنوعی | اقتصاد ورژن ۲.۰) دیدیم، هوش مصنوعی هیچ تهدید اقتصادیای نیز به همراه ندارد. هوش مصنوعی باعث بیمصرف شدن نیروی کار انسان و ایجاد بیکاری گسترده نخواهد شد. هوش مصنوعی سرمایهای مولد است، بنابراین تا جایی ارزش دارد که با کمک به تأمین نیازهای مصرفکنندگان، به آنها خدمت کند. یک هوش مصنوعی که به درستی مورد استفاده قرار نگیرد، به اندازه یک کارخانهی بلااستفاده ارزش دارد و احتمالاً تنها به درد اسقاط شدن میخورد. با این حال، این به آن معنا نیست که هوش مصنوعی هیچ تأثیری بر اقتصاد نخواهد گذاشت. قطعاً تأثیر خواهد گذاشت، درواقع هماکنون نیز تأثیر گذاشته است، اما این تأثیر در کوتاهمدت به اندازهی ترس برخی، بزرگ نیست و به احتمال زیاد در بلندمدت از آنچه انتظار داریم، بیشتر خواهد بود.

آیا هوش مصنوعی واقعاً شغل ما را خواهد دزدید؟

تهدید اصلی: تحریف حقیقت

در حقیقت، تهدیدِ واقعیِ هوش مصنوعی، تأثیر آن بر اطلاعات است. بخشی از این موضوع به این دلیل است که استقرا، منبع مناسبی برای دانش نیست. حقیقت و واقعیت، مسألهی فراوانی یا احتمالات آماری نیستند. شواهد و نظریههای کوپرنیک و گالیله، در صورت آموزش هوش مصنوعی بر اساس تمام (بهترین و درخشانترین) متون مربوط به زمینمرکزی در آن زمان، بعید (غلط) تلقی میشدند. اگر تنها به نظریههای تاریخی و ارائهی واقعیت از گذشته اعتماد کنیم، هیچ پیشرفتی حاصل نخواهد شد و هیچ حقیقتِ جدیدی آموخته نمیشود.

با این حال، به احتمال زیاد با برنامهنویسی هوشمندانه (به معنای اعمال قوانین و محدودیتهای مبتنی بر واقعیت بر مسئلهی استقرا)، دستکم تا حدی میتوان بر این مشکل غلبه کرد. مشکل بزرگتر، تحریف خروجی هوش مصنوعی است: اطلاعات غلط، گمراهکننده و مغرضانهای که نه تنها سازندگان و مدیران ابزارهای هوش مصنوعی، بلکه حتی دولتها و گروههای فشار، هوش مصنوعی را به منظور کنترل یا هدایت افکار عمومی یا دانش، برای تولید آنها سوق میدهند، مشکل اساسی و بزرگتر است.

این همان خطری است که نامهی سرگشادهی مشهوری که اکنون امضای ایلان ماسک، استیو وازنیاک و دیگران را دارد، به آن اشاره میکند: “آیا باید اجازه دهیم ماشینها کانالهای اطلاعاتی ما را با تبلیغات و دروغپراکنی پر کنند؟ آیا باید همهی مشاغل، حتی مشاغل رضایتبخش را به طور خودکار از بین ببریم؟ آیا باید اذهانی غیرانسانی را توسعه دهیم که ممکن است نهایتاً از نظر تعداد، هوش و کارایی از ما پیشی بگیرند، ما را منسوخ کنند و جایگزین ما شوند؟ آیا باید خطر از دست دادن کنترل تمدن خود را به جان بخریم؟”

به استثنای اشاره بیاساس و ناآگاهانه به “خودکارسازی همهی مشاغل”، این هشدار، بجا و پذیرفتنی است. این نکته درست است که هوش مصنوعی همچون شخصیتهای فیلم ترمیناتور از ما متنفر نخواهد شد و سعی در نابودی نسل بشر نخواهد کرد؛ و یا مانند آنچه در فیلم ماتریکس نشان داده شد، ما را به باتریهای بیولوژیکی تبدیل نخواهد کرد. با این حال، هوش مصنوعی، به ویژه زمانی که به سوی کارهای نادرست هدایت شود، باعث کجفهمی و گمراهیِ ما خواهد شد، هرج و مرج و آشوب ایجاد خواهد کرد و احتمالاً زندگی ما را “تنها، فقیرانه، زننده، حیوانی و کوتاهتر” خواهد ساخت.

اگر محتوای ما برایتان جذاب بود و چیزی از آن آموختید، لطفاً لحظهای وقت بگذارید و این چند خط را بخوانید:

ما گروهی کوچک و مستقل از دوستداران علم و فناوری هستیم که تنها با حمایتهای شما میتوانیم به راه خود ادامه دهیم. اگر محتوای ما را مفید یافتید و مایلید از ما حمایت کنید، سادهترین و مستقیمترین راه، کمک مالی از طریق لینک دونیت در پایین صفحه است.

اما اگر به هر دلیلی امکان حمایت مالی ندارید، همراهی شما به شکلهای دیگر هم برای ما ارزشمند است. با معرفی ما به دوستانتان، لایک، کامنت یا هر نوع تعامل دیگر، میتوانید در این مسیر کنار ما باشید و یاریمان کنید. ❤️